- 1. L’AGI : comprendre l’intelligence artificielle générale

- 2. DeepMind (Google) : à la frontière de la cognition humaine

- 3. Une superintelligence dès 2035 selon Demis Hassabis

- 4. Les machines seront-elles conscientes ?

- 5. AlphaFold : la révolution de la biologie prédictive

- 6. IA et résolution des crises sanitaires et climatiques

- 7. Geoffrey Hinton : la peur légitime du pionnier

- 8. Bill Gates : entre progrès thérapeutique et chaos potentiel

- 9. Gouvernance de l’IA : la nécessité d’un cadre international

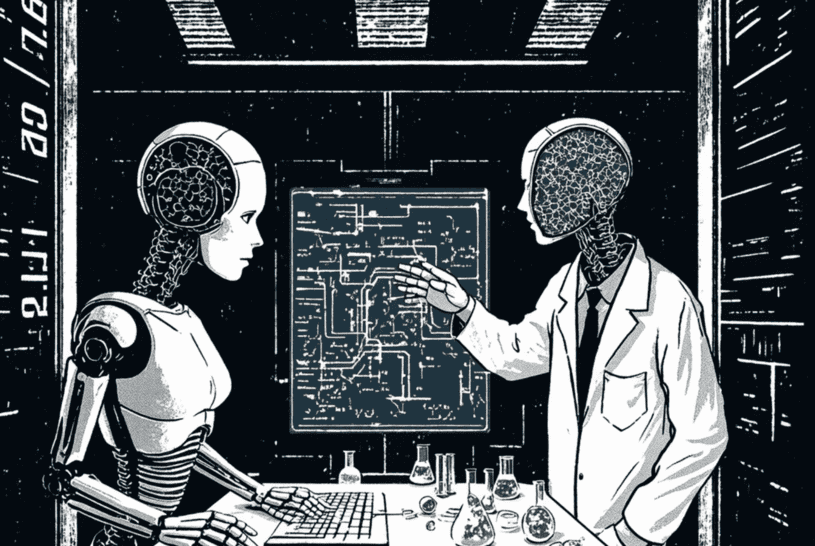

1. L’AGI : comprendre l’intelligence artificielle générale

L’Artificial General Intelligence (AGI), ou intelligence artificielle générale, désigne un type d’IA théorique capable d’exécuter toute tâche intellectuelle qu’un humain est en mesure d’accomplir. Contrairement à l’IA spécialisée (narrow AI) qui domine actuellement les applications (chatbots, moteurs de recommandation, modèles de traduction), l’AGI viserait une autonomie cognitive complète, une capacité d’apprentissage transversal, et potentiellement des formes émergentes de conscience.

À ce jour, aucun système ne remplit encore les critères scientifiques reconnus de l’AGI. Toutefois, les progrès récents dans les modèles de langage à grande échelle (large language models) et en robotique avancée laissent entrevoir une transition technologique inévitable dans la décennie à venir.

2. DeepMind (Google) : à la frontière de la cognition humaine

Demis Hassabis, neuroscientifique et PDG de DeepMind (filiale de Google), a été l’un des premiers à faire converger neurosciences computationnelles et intelligence artificielle. Lors d’une interview accordée à 60 Minutes (CBS, 20 avril 2025), il a affirmé que l’AGI pourrait devenir une réalité entre 2030 et 2035, affirmant que ses équipes sont « sur la bonne trajectoire » pour développer des systèmes à cognition humaine [CBS, 2025].

3. Une superintelligence dès 2035 selon Demis Hassabis

Selon Hassabis, les systèmes d’IA actuels n’ont ni imagination propre, ni capacité intuitive. Mais cette limite pourrait être dépassée rapidement. Il prédit que d’ici une décennie, nous disposerons d’un système capable de raisonner dans des contextes complexes, comprendre l’environnement physique et émotionnel, et apprendre en autonomie. Il évoque également des progrès imminents en robotique humanoïde, capable de reproduire les gestes humains avec souplesse et adaptabilité.

4. Les machines seront-elles conscientes ?

L’un des débats scientifiques majeurs est la possibilité d’une conscience machine. Hassabis lui-même admet que la reconnaissance de la conscience chez une IA serait extraordinairement difficile : « Même si un agent reproduit des comportements humains, cela ne prouve pas qu’il ressente quoi que ce soit. » Cette position soulève des questions éthiques fondamentales, en particulier dans les domaines de la neurophilosophie, du droit de l’IA et de l’éthique computationnelle.

5. AlphaFold : la révolution de la biologie prédictive

L’un des plus grands succès récents de l’IA appliquée est AlphaFold, développé par DeepMind et publié dans Nature en 2021. Cet algorithme d’apprentissage profond prédit la structure tridimensionnelle des protéines à partir de leur séquence génétique avec une précision quasi expérimentale. Alors que seuls 1 % des structures protéiques étaient connues auparavant, AlphaFold a permis de cartographier plus de 200 millions de protéines en moins d’un an [Nature, 2021].

6. IA et résolution des crises sanitaires et climatiques

Hassabis affirme que l’IA pourrait permettre de vaincre l’ensemble des maladies humaines d’ici quelques décennies, en combinant prédiction moléculaire, personnalisation des traitements et accélération du design de médicaments. Il voit également l’IA comme un outil stratégique pour atténuer les effets du changement climatique, via l’optimisation énergétique, la modélisation climatique et la gestion automatisée des ressources.

7. Geoffrey Hinton : la peur légitime du pionnier

À l’opposé du discours de Hassabis, le Dr Geoffrey Hinton – considéré comme le « père du deep learning » – a quitté son poste chez Google en 2023, invoquant sa préoccupation croissante sur les risques existentiels de l’IA. Il a déclaré à la BBC : « Dans les 20 prochaines années, il est probable que des IA plus intelligentes que les humains soient développées. Et cela est extrêmement préoccupant. » [BBC, 2023]

8. Bill Gates : entre progrès thérapeutique et chaos potentiel

Dans une interview avec Jimmy Fallon, le fondateur de Microsoft, Bill Gates, a reconnu le rôle moteur de l’IA dans l’innovation médicale et éducative. Il a toutefois souligné que nous entrons dans un « territoire entièrement nouveau », et que la société pourrait perdre le contrôle si les régulations ne sont pas mises en place à temps.

9. Gouvernance de l’IA : la nécessité d’un cadre international

Tous les experts convergent sur un point : l’urgence d’une gouvernance mondiale de l’IA. Hassabis plaide pour une évaluation continue des risques liés aux IA avancées, un contrôle de leurs capacités, et l’établissement de normes internationales. À défaut, les dérives potentielles – militaires, économiques, ou sociétales – pourraient échapper à tout contrôle humain.

Références scientifiques et médiatiques :